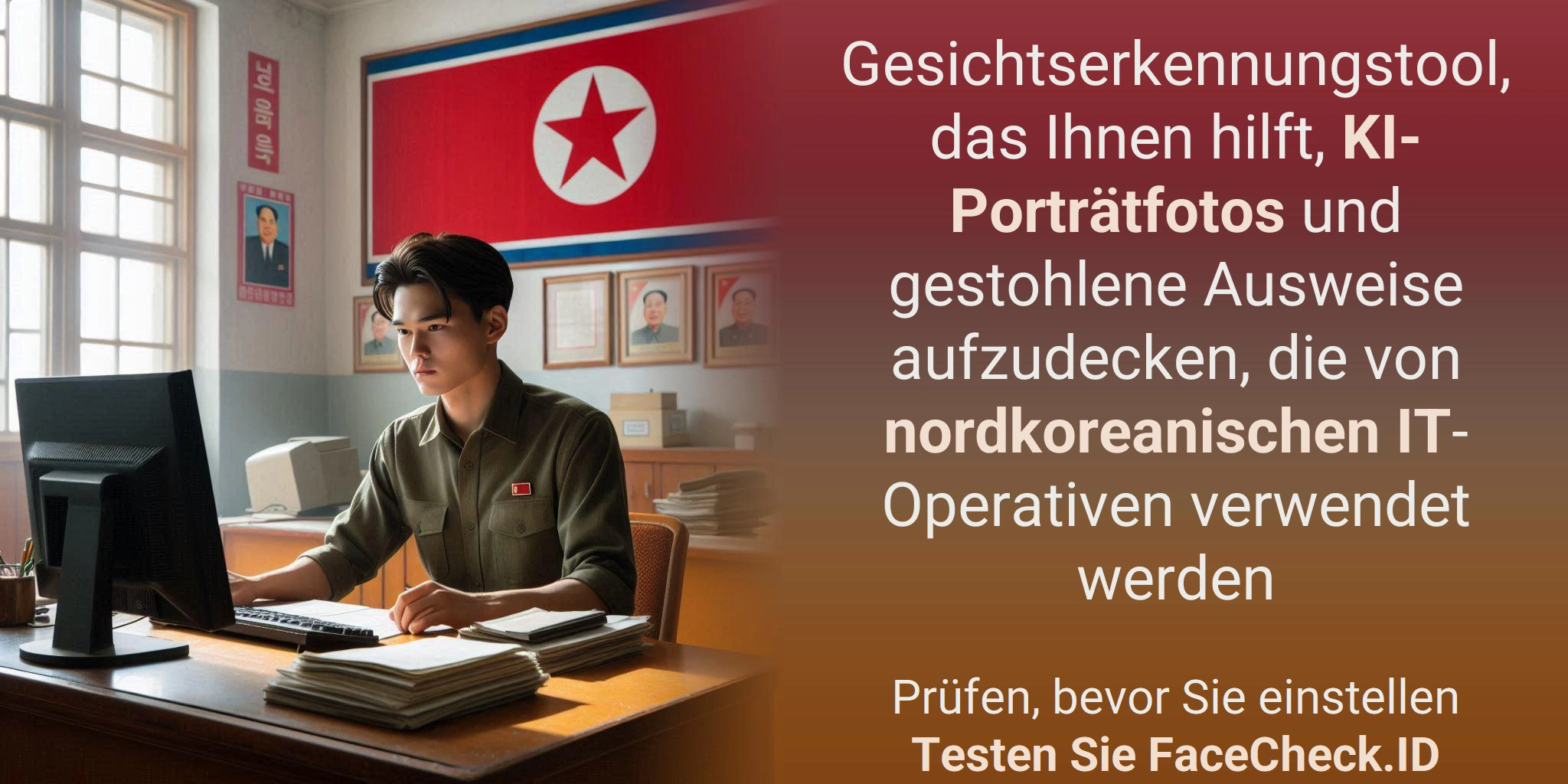

Wie man gefälschte Remote-IT-Mitarbeiter mit Gesichtserkennung enttarnt (Leitfaden 2026)

Stoppen Sie nordkoreanischen IT-Betrug, KI-generierte Porträtfotos & gestohlene Identitäten, bevor Sie einstellen

Remote-Einstellungen haben die Skalierung von Technologieteams revolutioniert, aber sie haben auch eine Chance für hochorganisierten Betrug geschaffen.

Nordkoreanische IT-Operative und andere betrügerische Akteure infiltrieren US-amerikanische und europäische Unternehmen, indem sie sich als Remote-Softwareentwickler, DevOps-Ingenieure, Data Engineers, Systemadministratoren und Cybersicherheits-Experten ausgeben. Sie nutzen gestohlene US-Identitäten, Stockfotos, KI-generierte Porträtfotos und Deepfake-gestützte Videointerviews, um gut bezahlte Tech-Positionen zu erlangen. Diese Gehälter finanzieren direkt sanktionierte Waffenprogramme und Cyber-Spionage-Operationen.

Traditionelle Background-Checks versagen, weil die Identität echt ist, aber die Person nicht.

Die Lösung im Jahr 2026? Schnelle, recruiterfreundliche Gesichtserkennungs-Tools zur Verifizierung, angeführt von FaceCheck.ID, die gefälschte Identitäten in unter 60 Sekunden erkennen.

In diesem Artikel werden wir diskutieren

- Warum FaceCheck.ID 2026 das beste Tool zur Erkennung gefälschter IT-Mitarbeiter ist

- Wie sich Fotobetrug entwickelt hat: Von Stockfotos zu KI-generierten Porträtfotos

- So verifizieren Sie Remote-Kandidaten in 30 Sekunden

- 4-stufige Anti-Betrugs-Pipeline für die Einstellung in Remote-Tech-Rollen

- Kombinieren Sie FaceCheck.ID mit Liveness-Verifizierung für vollständigen Schutz

- Aktuelle Taktiken falscher IT-Arbeitskräfte und nordkoreanischer Operative (2026)

- Warnsignale: So erkennen Sie gefälschte Remote-Entwicklerkandidaten

- Ist Gesichtserkennung für Einstellungen legal? Compliance-Aspekte

- ROI: Die tatsächlichen Kosten der Einstellung eines falschen Remote-IT-Arbeiters

- Schützen Sie Ihr Unternehmen vor falschen Remote-IT-Arbeitern

- Häufig gestellte Fragen

- 📰 Aktuelle Schlagzeilen

- Zentrale Erkenntnisse: Infiltration durch nordkoreanische Remote-IT-Arbeiter (2026)

- 🔥 1. Die Bedrohung ist nicht mehr auf Tech oder die USA beschränkt

- 🧠 2. Die Operativen werden immer raffinierter

- 🛡️ 3. Ihre Ziele gehen über die Einnahmeerzielung hinaus

- 🤖 4. Ausweitung auf KI und hochwirksame Rollen

- 🌍 5. Länder, für die die Bedrohung neu ist, sind anfälliger

- 🛠️ 6. Identitätsprüfung ist jetzt eine Sicherheitsanforderung

- ⚠️ 7. Es wird mit einer Eskalation gerechnet, da die Strafverfolgung zunimmt

- 📌 Fazit

Warum FaceCheck.ID 2026 das beste Tool zur Erkennung gefälschter IT-Mitarbeiter ist

FaceCheck.ID ist keine generische Reverse-Bildersuchmaschine. Es wurde speziell für die Aufdeckung von Identitätsbetrug entwickelt und ist gegen den weltweit größten Datensatz von Profilfotos von Tech-Mitarbeitern indexiert.

Die durchsuchbare Datenbank umfasst:

- GitHub-, GitLab-, Bitbucket-Avatare

- Öffentliche LinkedIn-Profilfotos

- Stack Overflow-, HackerRank-, LeetCode-, CodeSignal-Profile

- Upwork-, Toptal-, Freelancer.com-, Fiverr-Porträtfotos

- Dev.to-, Hashnode-, Medium-Autorenfotos

- Docker Hub-, npm-, PyPI-Maintainer-Bilder

- Speaker-Seiten von Tech-Konferenzen (AWS re: Invent, DEF CON, PyCon usw.)

- Reddit-, Discord-, X.com-Avatare

- Persönliche Portfolioseiten & About.me-Seiten

- Unternehmensseiten „Lernen Sie unser Team kennen“

- Fahndungs- und Scam-Watch-Datenbanken

- Stockfoto-Bibliotheken (Shutterstock, Pexels, Adobe Stock, Unsplash, Getty Images)

- Archive KI-generierter Gesichter (StyleGAN, Midjourney, DALL-E)

Dies ermöglicht FaceCheck.ID, die zwei entscheidenden Fragen zu beantworten, die jedes Recruiting-Team stellen muss:

1. Ist dieses Gesicht bereits online erschienen und unter welchen Namen?

Legitime Softwareentwickler haben in der Regel eine konsistente Online-Spur.

Betrügerische Kandidaten haben oft keine oder tauchen unter mehreren Identitäten auf.

2. Ist dieses Foto KI-generiert, manipuliert, gestohlen oder aus einer Stockbibliothek?

FaceCheck.ID erkennt:

- GAN-Artefakte und Verzerrungen

- Deepfake-Manipulationsspuren

- Hinweise auf Face-Swaps

- Treffer in Stockfoto-Datenbanken

- KI-generierte synthetische Porträtfotos

- Fotos gestohlener Identitäten

- Doppelte Gesichter, die mit mehreren Aliasen verknüpft sind

Betrug wird gestoppt, bevor Interviews überhaupt beginnen.

Wie sich Fotobetrug entwickelt hat: Von Stockfotos zu KI-generierten Porträtfotos

Als die ersten Betrugsmaschen mit gefälschten Remote-IT-Mitarbeitern auftauchten, setzten die Betrüger stark auf Stockfotos. Diese polierten, geschäftsmäßigen Porträtfotos waren leicht zu erwerben und für Recruiter schwer zurückzuverfolgen.

Mit der Verbesserung der Erkennungstools passten sich die Betrugsgruppen an.

KI-generierte Porträtfotos haben Stockfotos als wichtigste Methode des Identitätsbetrugs abgelöst

KI-generierte Profilfotos ermöglichen es Betrügern:

- Hyperrealistische, recruiterfreundliche Gesichter sofort zu erzeugen

- Unbegrenzt viele einzigartige Fake-Identitäten in großem Maßstab zu erstellen

- Bilder mit null Reverse-Image-Such-Fußabdruck zu generieren

- der Erkennung durch bekannte Stock-Modelle zu entgehen

- Alter, Ethnizität, Kleidung und Gesichtsausdruck in Sekunden anzupassen

Fortgeschrittene Betrugsringe betreiben inzwischen ganze Pipelines, die massenhaft Fake-Personas produzieren, die synthetische Gesichter, geklonte Stimmen und frei erfundene Lebensläufe kombinieren.

FaceCheck.ID ist eines der wenigen leichtgewichtigen Tools, das sowohl Stockfoto-Betrug als auch KI-generierte Identitätsfälschung erkennen kann.

So verifizieren Sie Remote-Kandidaten in 30 Sekunden

- Speichern Sie das LinkedIn-, GitHub- oder Lebenslauf-Foto des Kandidaten

- Besuchen Sie https://FaceCheck.ID

- Ziehen Sie das Bild per Drag & Drop hinein

- Prüfen Sie die sofortigen Ergebnisse, darunter:

- KI-Generierungs-Wahrscheinlichkeitsscore

- Bewertung der Identitätskonsistenz

- Mapping des Online-Fußabdrucks

- Alias- und Namensabweichungs-Warnungen

- Erkennung von Stockfoto-Quellen

- Deepfake- und Manipulationshinweise

- Treffer in Scam-Datenbanken und Fahndungsfotos

Praxisbeispiele, mit denen Recruiter täglich konfrontiert sind:

- Dasselbe Gesicht taucht unter drei verschiedenen Namen auf unterschiedlichen Plattformen auf

- Profilfoto weist 97 % Wahrscheinlichkeit für KI-Generierung auf

- „Senior Engineer“ mit 10 Jahren Erfahrung hat keinerlei Online-Präsenz

- Porträtfoto zurückverfolgt zu Shutterstock mit dem Titel:

„Junger Geschäftsmann lächelt in modernem Büro, lizenzfreies Stockbild“

4-stufige Anti-Betrugs-Pipeline für die Einstellung in Remote-Tech-Rollen

| Einstellungsphase | FaceCheck.ID-Aktion | Zweck der Betrugsprävention | Erforderliche Zeit |

|---|---|---|---|

| Bewerbungsprüfung | LinkedIn-/Lebenslauffoto scannen | Stockfotos, KI-Gesichter, bekannte Aliasnamen herausfiltern | 30 Sek. |

| Nach dem Telefon-Screening | Aktuelles Selfie anfordern | Imitationen und Deepfake-Versuche aufdecken | 45 Sek. |

| Video-Interview | Screenshot während des Gesprächs → mit Profil vergleichen | Gesichtsabweichungen und Live-Deepfakes erkennen | 20 Sek. |

| Verifizierung vor dem Angebot | Abschließende Selfie-Bestätigung | Zugang zu Laptop und VPN für Betrüger verhindern | 1 Min. |

Diese Pipeline eliminiert 90–95 % der betrügerischen Kandidaten, bevor sie die Engineering-Teams erreichen oder Geräte erhalten.

Kombinieren Sie FaceCheck.ID mit Liveness-Verifizierung für vollständigen Schutz

FaceCheck.ID verifiziert die Identität.

Liveness-Erkennung verifiziert den lebenden Menschen.

| Liveness-Tool | Kosten pro Prüfung (2026) | Bestes Einsatzszenario |

|---|---|---|

| Entrust | 1,50–2,00 $ | Vollständige Ausweisprüfung + Liveness-Verifizierung |

| Sumsub | ca. 1,00 $ | Automatisierte Workflow-Integration |

| Veriff | 1,00–2,00 $ | Beste mobile User Experience |

| IDLive Face | ca. 0,50 $ | Passive Liveness (keine Benutzeraktion erforderlich) |

Zusammen schließen diese Tools jede größere Identitätsbetrugslücke beim Remote-Hiring.

Aktuelle Taktiken falscher IT-Arbeitskräfte und nordkoreanischer Operative (2026)

Moderne Betrugsoperationen nutzen:

- KI-generierte oder Stockfoto-Profilbilder

- Gestohlene Sozialversicherungsnummern mit gültiger Kredithistorie

- Echtzeit-Deepfake-Video-Overlays während Live-Interviews

- Stimmklone, die zu Ausweisdokumenten passen

- Remote-Desktop-„Ghost Coder“, die technische Assessments erledigen

- KI-geschriebene Lebensläufe kombiniert mit synthetischen Porträtfotos

- Telegram-basierte Helfer, die Live-Coaching während Interviews geben

Identitätsprüfung ist jetzt eine Anforderung der Cybersicherheit, keine HR-Formalität.

Warnsignale: So erkennen Sie gefälschte Remote-Entwicklerkandidaten

Identitätswarnzeichen

- Profilfoto erscheint auf Stockfoto-Webseiten

- Dasselbe Gesicht ist online mit 2–5 verschiedenen Namen verknüpft

- KI-Artefakte (Asymmetrie, Unschärfe, ungewöhnliche Hintergründe)

- Kein Online-Fußabdruck trotz angeblicher „Senior-Level“-Erfahrung

- LinkedIn-Konto wurde in den letzten 6 Monaten erstellt

Verhaltenswarnzeichen

- Kamera während Videoanrufen deaktiviert oder „kaputt“

- Verweigert die Einreichung eines aktuellen Selfies zur Verifizierung

- Gesicht im Live-Video stimmt nicht mit dem Profilfoto überein

- Skriptartige, einstudierte oder verzögerte Interviewantworten

- Sichtbare Augenbewegungen, die auf Coaching außerhalb des Bildschirms hindeuten

Technische Warnzeichen

- GitHub-Repositories wurden kürzlich oder in großer Zahl erstellt

- Codebeispiele zeigen KI-Generierungsmuster

- VPN-Standort stimmt nicht mit dem angegebenen Wohnort überein

- Unstimmigkeiten bei der IP-Geolokalisierung

Zwei oder mehr Warnsignale → sofort mit FaceCheck.ID verifizieren.

Ist Gesichtserkennung für Einstellungen legal? Compliance-Aspekte

FaceCheck.ID ist bei korrekter Implementierung konform:

- Analysieren Sie nur vom Kandidaten bereitgestellte oder öffentlich verfügbare Bilder

- Nehmen Sie einen Hinweis zur Verifizierung in Ihren Bewerbungsprozess auf

- FaceCheck.ID speichert keine biometrischen Templates

- FCRA gilt nur, wenn es für Entscheidungen zur Strafhistorie verwendet wird

- Zweck ist Betrugsprävention, nicht diskriminierende Einstellungskriterien

Seriöse Kandidaten profitieren von schnellerer Verifizierung. Betrüger werden vor dem Onboarding gestoppt.

ROI: Die tatsächlichen Kosten der Einstellung eines falschen Remote-IT-Arbeiters

Jede betrügerische Remote-Einstellung schafft ein erhebliches Risiko:

- 8.000–35.000 $ an verlorenen Laptop-, Geräte- und Bereitstellungskosten

- Quellcode-Diebstahl und Kompromittierung der Infrastruktur

- OFAC-Strafen für die Beschäftigung sanktionierter Personen

- Vertrauensverlust bei Kunden und Risiko der Kündigung von Verträgen

- Rechtliche Haftung und Reputationsschäden

- Mögliche Anforderungen zur Meldung von Datenschutzverletzungen

Die Kosten für eine FaceCheck.ID-Verifizierung: 0,30 USD.

Die Kosten für eine betrügerische Einstellung: potenziell katastrophal.

Internet-Fußabdruck schnell prüfen

Schützen Sie Ihr Unternehmen vor falschen Remote-IT-Arbeitern

Remote-Hiring ist nicht mehr nur ein einfacher HR-Workflow, sondern ein Thema der Cyber- und nationalen Sicherheit.

FaceCheck.ID bietet Personalabteilungen Identitätsprüfungsfunktionen, die früher nur Regierungsbehörden und Elite-Sicherheitsteams zur Verfügung standen. Es erkennt:

- Stockfoto-Identitäten

- KI-generierte synthetische Porträtfotos

- Deepfake-Video-Imitatoren

- Betrug mit gestohlenen Identitäten

- Mehrfachalias-Betrugsnetzwerke

- Nordkoreanische IT-Operative

- Insider-Threat-Kandidaten

Eine einzige 60-Sekunden-Fotosuche kann Ihr Unternehmen, Ihr Engineering-Team, Ihren Code und Ihren Ruf schützen.

Bevor Sie Ihren nächsten Laptop ausgeben:

✔️ Lassen Sie das Gesicht prüfen unter https://FaceCheck.ID

Häufig gestellte Fragen

Wie erkenne ich, ob das Foto eines Kandidaten KI-generiert ist?

Laden Sie das Bild bei FaceCheck.ID hoch. Das Tool liefert eine Wahrscheinlichkeitsbewertung für KI-Generierung und markiert Indikatoren für synthetische Gesichter, einschließlich GAN-Artefakten und Manipulationsspuren.

Kann FaceCheck.ID Betrug durch nordkoreanische IT-Arbeiter erkennen?

Ja. FaceCheck.ID gleicht Gesichter mit bekannten Betrugsdatenbanken ab, erkennt Mehrfachalias-Muster und identifiziert Fotos ohne legitime Online-Historie – häufige Indikatoren für mit der DVRK verbundene Operative.

Was ist der Unterschied zwischen Stockfoto-Erkennung und Erkennung von KI-Gesichtern?

Stockfoto-Erkennung identifiziert Bilder, die aus kommerziellen Bildbibliotheken wie Shutterstock oder Getty lizenziert sind. KI-Gesichterkennung identifiziert synthetisch generierte Gesichter, die mit Tools wie StyleGAN, Midjourney oder anderen generativen Modellen erstellt wurden.

Ist der Einsatz von Gesichtserkennung im Recruiting legal?

Wenn sie auf vom Kandidaten bereitgestellte oder öffentlich verfügbare Bilder zu Betrugspräventionszwecken beschränkt ist, ist Gesichtserkennungs-Überprüfung in den meisten Rechtsordnungen legal. Nehmen Sie immer eine entsprechende Offenlegung in Ihren Bewerbungsprozess auf.

📰 Aktuelle Schlagzeilen

|

14. Nov. 2025 — US-Justizministerium (DOJ) kündigt Anklagen in großangelegtem nordkoreanischen IT-Arbeiter-Schema an DOJ und FBI erhoben Anklage gegen ein Netzwerk, das nordkoreanischen Operativen ermöglichte, gestohlene US-Identitäten, „Laptop-Farmen“ und Schein-Konten zu nutzen, um in mehr als 100 US-Unternehmen einzudringen. Der Fall verdeutlicht die realen Risiken, wenn betrügerische Remote-IT-Arbeiter Zugang zur Unternehmensinfrastruktur erhalten. Quelle: justice.gov |

|

17. Nov. 2025 — US-Bürger und ukrainischer Staatsangehöriger bekennen sich schuldig, DVRK-gebundenen Remote-IT-Betrug unterstützt zu haben Fünf Personen gaben zu, nordkoreanische Operative unterstützt zu haben, indem sie gestohlene Identitäten bereitstellten, Arbeitgeber-Laptops hosteten und unbefugten Remote-Zugang ermöglichten. Mehr als 136 Unternehmen waren betroffen, was zeigt, wie tief DVRK-verbundene Arbeitskräfte in das Remote-Hiring-Ökosystem eingedrungen sind. Quelle: cybersecuritydive.com |

|

Juli 2025 — RCMP gibt Warnhinweis an kanadische Unternehmen zu DVRK-IT-Arbeiter-Schemata heraus Kanadische Strafverfolgungs- und Sicherheitsbehörden warnten Unternehmen, dass das unbeabsichtigte Einstellen nordkoreanischer IT-Arbeiter sie Sanktionen, Datendiebstahl und operativen Risiken aussetzen könnte. Die Mitteilung bestätigt, dass diese Schemata global sind und nicht nur die USA betreffen. Quelle: rcmp.ca |

|

Aug. 2025 — Infiltration durch nordkoreanische Remote-Arbeiter breitet sich über den Technologiesektor hinaus aus Threat-Intelligence-Analysten berichten, dass DVRK-Remote-Arbeiter-Operationen nun auch auf Rollen in den Bereichen Finanzen, Gesundheitswesen und öffentliche Verwaltung abzielen. Betrugsringe setzen zunehmend KI-generierte Lebensläufe und synthetische Porträtfotos ein, um der Erkennung zu entgehen und ihre Fähigkeit zu beschleunigen, weltweit in Unternehmen einzudringen. Quelle: securityboulevard.com |

Zentrale Erkenntnisse: Infiltration durch nordkoreanische Remote-IT-Arbeiter (2026)

Dies sind die wichtigsten Erkenntnisse aus aktuellen Threat-Intelligence-Recherchen zu den wachsenden Remote-IT-Arbeiter-Operationen Nordkoreas. Diese Punkte unterstreichen die Notwendigkeit stärkerer Identitätsprüfungsprozesse, insbesondere für Unternehmen, die Remote-Tech-Talente einstellen.

🔥 1. Die Bedrohung ist nicht mehr auf Tech oder die USA beschränkt

- Nur 50 % der angegriffenen Organisationen stammen aus dem Technologiesektor.

- Mit der DVRK verbundene Bewerber zielen nun auf Rollen in:

- Gesundheitswesen

- Finanzen

- Öffentlicher Verwaltung

- Professionellen Dienstleistungen

- KI- und Ingenieurrollen

- 27 % der Opfer befinden sich außerhalb der USA, darunter das Vereinigte Königreich, Deutschland, Kanada, Indien und Australien.

Jedes Unternehmen, das Remote- oder Hybridrollen anbietet, ist jetzt ein Ziel.

🧠 2. Die Operativen werden immer raffinierter

DPRK-IT-Arbeiter nutzen zunehmend:

- Gestohlene oder synthetische Identitäten

- Gefälschte Lebensläufe und berufliche Werdegänge

- KI-generierte Porträtfotos

- Deepfake-Videos und Stimmklonen während Interviews

Jahrelange Infiltration von US-Unternehmen hat ein ausgereiftes, gut angepasstes Vorgehensmodell hervorgebracht, um traditionelle Einstellungsprozesse zu umgehen.

Standardisierte Interviews und Hintergrundüberprüfungen können diese Akteure nicht stoppen.

🛡️ 3. Ihre Ziele gehen über die Einnahmeerzielung hinaus

Während die Operationen schätzungsweise 250–600 Mio. US-Dollar pro Jahr einbringen, bringen Forscher DPRK-Arbeiter in Verbindung mit:

- Datendiebstahl

- Sammeln von Zugangsdaten

- Erpressung

- Ransomware-Operationen

- Vorab eingerichteten Zugängen für Spionagezwecke

Die Einstellung eines betrügerischen Remote-Mitarbeiters kann zu einem Cybersicherheitsvorfall werden.

🤖 4. Ausweitung auf KI und hochwirksame Rollen

Seit 2023 zielen DPRK-Arbeiter verstärkt auf:

- KI-Engineering-Positionen

- KI-Start-ups

- Unternehmen, die KI in Arbeitsabläufe integrieren

Diese Tätigkeiten ermöglichen den Zugriff auf sensible Infrastrukturen und Zukunftstechnologien.

🌍 5. Länder, für die die Bedrohung neu ist, sind anfälliger

Zuvor nicht betroffene Nationen verfügen oft nicht über:

- Starke Identitätsprüfungsverfahren

- Insider-Bedrohungsprogramme

- Bewusstsein für Betrugstaktiken der DPRK bei der Beschäftigung

Die globale Ausweitung bedeutet, dass weniger vorbereitete Märkte höheren Risiken ausgesetzt sind.

🛠️ 6. Identitätsprüfung ist jetzt eine Sicherheitsanforderung

Forscher empfehlen:

- Fotobasierte Identitätsprüfung (z. B. FaceCheck.ID)

- Strengere Bewerber-Screenings

- Segmentierte und rollenbasierte Zugriffskontrollen

- Überwachung von Auftragnehmern/Drittparteien

- Aufbau von Insider-Bedrohungsprogrammen

Identitätsprüfung ist jetzt Teil der Cybersicherheit – nicht der Personalabteilung.

⚠️ 7. Es wird mit einer Eskalation gerechnet, da die Strafverfolgung zunimmt

US-Strafverfolgungsmaßnahmen – Anklagen, Beschlagnahmung von Domains und Schließung von „Laptop-Farmen“ – stören die Einnahmequellen. Analysten warnen, dass dies führen könnte zu:

- Mehr Spionage

- Mehr zerstörerischen Angriffen

- Zunehmender Ransomware-Aktivität

Die Bedrohung reift und könnte aggressiver werden.

📌 Fazit

Die IT-Arbeiter-Operationen Nordkoreas haben sich zu einer globalen, branchenübergreifenden, hochentwickelten Kampagne entwickelt, die durch traditionelle Einstellungsverfahren nicht erkannt werden kann. Organisationen müssen Identitäts- und Zugriffskontrollen stärken, um sich vor Infiltration, Spionage und finanziellen Verlusten zu schützen.

Erfahren Sie mehr...

Demaskierung von Liebesbetrug: Expertentipps zur Identifizierung und Vermeidung von Opferfallen

Emotionale Manipulation, gefälschte Profile und plötzliche Geldforderungen – Liebesbetrüger nutzen perfide Taktiken, um Vertrauen aufzubauen und dann zuzuschlagen. Erfahren Sie, welche Warnsignale Sie auf keinen Fall ignorieren sollten und wie die 7-Tage-Regel Sie vor finanziellen und emotionalen Schäden schützen kann.

Zum Thema in anderen Sprachen

How to Detect Fake Remote IT Workers with Facial Recognition (2026 Guide)

Como Detectar Falsos Trabalhadores de TI Remotos com Reconhecimento Facial (Guia 2026)

如何利用人脸识别识破虚假远程 IT 员工(2026 指南)

Jak odhalit falešné vzdálené IT pracovníky pomocí rozpoznávání obličeje (průvodce 2026)

Cómo detectar falsos trabajadores de TI remotos con reconocimiento facial (Guía 2026)

Comment détecter les faux informaticiens à distance grâce à la reconnaissance faciale (Guide 2026)

Come Riconoscere Falsi Lavoratori IT da Remoto con il Riconoscimento Facciale (Guida 2026)

偽のリモートITワーカーを顔認証で見抜く方法(2026年版ガイド)

얼굴 인식으로 가짜 원격 IT 근로자를 적발하는 방법 (2026 가이드)

Jak wykrywać fałszywych zdalnych pracowników IT za pomocą rozpoznawania twarzy (poradnik 2026)

Как выявлять фальшивых удалённых IT-специалистов с помощью распознавания лиц (гид 2026 года)

كيفية اكتشاف موظفي تقنية معلومات عن بُعد مزيفين باستخدام التعرّف على الوجه (دليل 2026)

Sahte Uzaktan BT Çalışanlarını Yüz Tanıma ile Tespit Etme (2026 Rehberi)

Beliebte Themen

Deepfake-Video Deepfake Identität Gesichtserkennung LinkedIn Betrüger Strafverfolgung Reddit Biometrisch FotosucheFaceCheck vs PimEyes: Welche Suchmaschine ist die beste?